A harmadik elméleti keret: Konnekcionizmus és PDP II.

A Konnekcionizmus második felvirágzását McClelland és Rumelhart 1986-os könyve alapján PDP-nek, Parallel Distributed Processing-nek hívják, ami magyarul annyit tesz Párhuzamos, Elosztott Feldolgozás. Ők itt az idegsejtek és hálózatok matematikai leírást finomították, megjelentek a többrétegű hálózatok, amelyekben a bemeneti és a kimeneti réteg között rejtett (hidden) rétegek is voltak. Illetve rájöttek arra, hogy egy modell idegsejt hálózat jobban működik, ha az idegsejtek küszöbfüggvénye nem lineáris, hanem szigmoid. Ez magyarra fordítva azt jelenti, hogy a sejt kimenete nem egyszerűen a bemenet összegével arányos, hanem a küszöbérték körül jelentősen megnő a kimenet erőssége. Ebbe most ne menjünk bele miért működik a lényeg az, hogy sokat használ.

A mozgalom mélyebben és pontosabbam megértette az idegsejthálók tulajdonságait, melyek a nevében is tükröződnek. A Párhuzamos azt jelenti, hogy a működés során nem egyenként értékelődnek ki az egyes idegsejtekre érkező bemenetek és ebből a válaszuk, hanem egyszerre, párhuzamosan, rétegről rétegre adódik át az információ, ráadásul egy többrétegű hálózatban minden rétegpár között egyszerre adódik át az információ. Mint ahogy egy igazán jó focimeccsen is az összes játékos egyszerre mozog, hogy a megfelelő pillanatban a jó helyen legyen, ellentétben egy gombfoci játékkal, ahol mindig csak egyetlen „játékost” lehet odébb pöccenteni. Például egy 4 rétegű, rétegenként 100 sejtes hálózatban egyszerre 300 számítás történik (az utolsó réteg csak kimenet).

A mozgalom mélyebben és pontosabbam megértette az idegsejthálók tulajdonságait, melyek a nevében is tükröződnek. A Párhuzamos azt jelenti, hogy a működés során nem egyenként értékelődnek ki az egyes idegsejtekre érkező bemenetek és ebből a válaszuk, hanem egyszerre, párhuzamosan, rétegről rétegre adódik át az információ, ráadásul egy többrétegű hálózatban minden rétegpár között egyszerre adódik át az információ. Mint ahogy egy igazán jó focimeccsen is az összes játékos egyszerre mozog, hogy a megfelelő pillanatban a jó helyen legyen, ellentétben egy gombfoci játékkal, ahol mindig csak egyetlen „játékost” lehet odébb pöccenteni. Például egy 4 rétegű, rétegenként 100 sejtes hálózatban egyszerre 300 számítás történik (az utolsó réteg csak kimenet).

Ezzel a megoldással össze is függ a második tag, az Elosztott. Egyrészt elosztott a reprezentáció az idegsejtek, csomópontok aktivitásának mintázatában, másrészt a memória, a tudás a rendszerben a kapcsolatok erősségének összességében található elosztva.

Ennek eredményeként egy PDP hálózatnak vannak, egymással összefonódóan jó és rossz tulajdonságai.

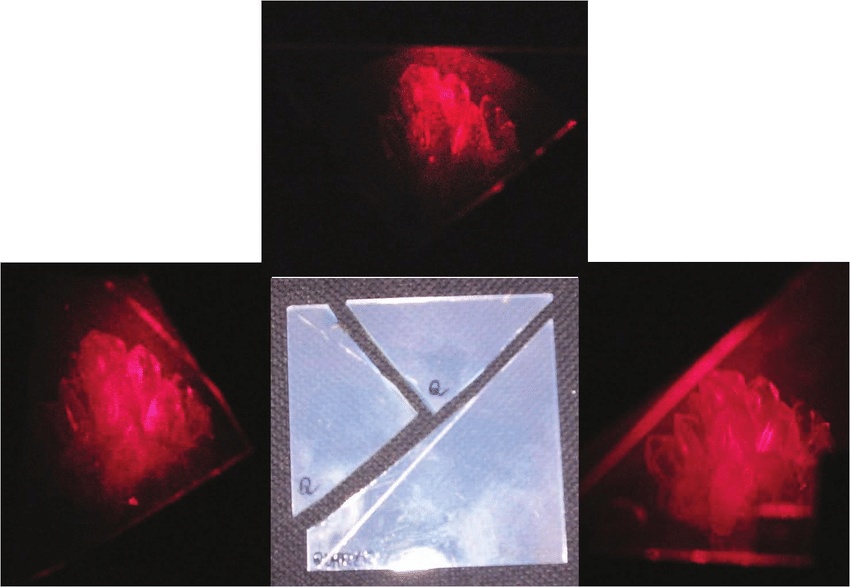

Jó tulajdonság 1: Mivel a reprezentáció és a tudás szétszórt a hálózatban, ezért a hálózat sérülésével arányos mértékben romlik annak működése, azaz robosztus. Ha egy kis része kiesik, sem a reprezentáció (a mintázatok, melyek a dolgokat jelentik) sem a tudás (a kapcsolatok) nem károsodik jelentősen. Kicsit homályosabb lesz a reprezentáció, kicsit hibás lesz a működés. Lásd a mátrix memória esetében korábban felhozott hologram hasonlatot: a hologram lemezt félbetörve a kép nem tűnik el csak homályosabb lesz.

Jó tulajdonság 1: Mivel a reprezentáció és a tudás szétszórt a hálózatban, ezért a hálózat sérülésével arányos mértékben romlik annak működése, azaz robosztus. Ha egy kis része kiesik, sem a reprezentáció (a mintázatok, melyek a dolgokat jelentik) sem a tudás (a kapcsolatok) nem károsodik jelentősen. Kicsit homályosabb lesz a reprezentáció, kicsit hibás lesz a működés. Lásd a mátrix memória esetében korábban felhozott hologram hasonlatot: a hologram lemezt félbetörve a kép nem tűnik el csak homályosabb lesz.

Jó tulajdonság 2: a rendszer gyors, mivel párhuzamosan zajlik benne a feldolgozás. Az agy még úgy is gyors, hogy elemei az idegsejtek jelentősen lassabbak, mint egy mikroprocesszorban a logikai elemek (tranzisztorok). Míg egy idegsejt másodpercenkét a legjobb esetben 150 műveletet tud végezni (a legmagasabb, egészséges agyban megfigyelt sejt tüzelési frekvenciája alapján), addig egy logikai elem manapság egy CPU-ban 5GHz körül ketyeg, azaz másodpercenként 5 milliárd műveletet végez. Agyunk egyenlőre, mégis gyorsabb (már nem sokáig) mint a Deep Learning hálózatok.

Rossz tulajdonság 1: Pont mivel a dolgok szétszórtak a rendszerben, nem lehet megérteni mi történik, hogy működik, hol vannak a tudás elemei, milyen lépesekben történik a feldolgozás. De nem csak mi, mint külső szemlélő nem értjük, a hálózat sem érti meg. Ebből fakad a:

Rossz tulajdonság 2: Mivel a neuronhálózatok példákból tanulnak, asszociációs párokat alkotnak, ezért (lásd az előző rossz tulajdonság) nem értik meg a feladatot, nem bontják elemekre. Ha azt mondod egy, azt mondja kettő, ha már találkozott ezzel a párral. Ennek következményeként nem képesek szabályokat alkotni és azokat használni. Nem tudnak általánosítani abból, hogy 1+1=2 arra, hogy 1+2=3.

Rossz tulajdonság 2: Mivel a neuronhálózatok példákból tanulnak, asszociációs párokat alkotnak, ezért (lásd az előző rossz tulajdonság) nem értik meg a feladatot, nem bontják elemekre. Ha azt mondod egy, azt mondja kettő, ha már találkozott ezzel a párral. Ennek következményeként nem képesek szabályokat alkotni és azokat használni. Nem tudnak általánosítani abból, hogy 1+1=2 arra, hogy 1+2=3.

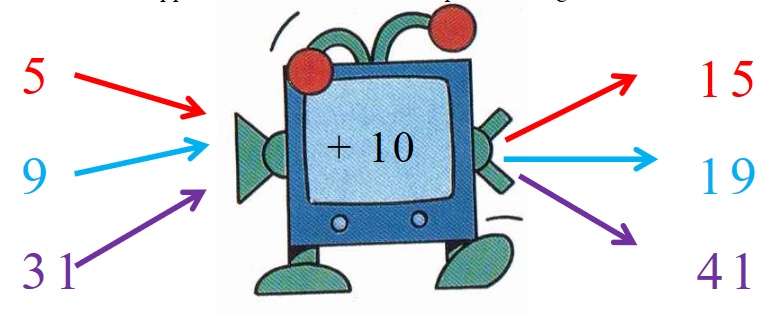

Mint az alacsony szakértelmű betanított gyári munkás, ha innen jön a cucc oda kell tenni, de ha valami változik nem tud helyesen dönteni, mert nem érti mit csinál.  Matematikusan fogalmazva a PDP hálózatok nem tudnak függvényeket használni, ahol a bemeneti értékek közötti művelet alapján keletkezik majd a végeredmény, mivel nem képesek műveleteket végezni. Biztos mindenki emlékszik általános iskolai matekórán a GÉP-re. Ezzel magyarázta el a matektanár a műveletek fogalmát. Bedobok egy számot és eggyel nagyobbat kapok, vagy egy másik gép megszorozza kettővel. Egy PDP háló meg tudja tanulni, hogy 1 után 2, 3 után 4 jön, de ha megkérded mi jön 5 után akkor valamit halangzsázni fog, mert ezzel a párral még nem találkozott. Bár egy kellően nagy és mély háló mint mostanában a ChatGPT esetében láthatjuk már ha jól kérdezzük képes erre.

Matematikusan fogalmazva a PDP hálózatok nem tudnak függvényeket használni, ahol a bemeneti értékek közötti művelet alapján keletkezik majd a végeredmény, mivel nem képesek műveleteket végezni. Biztos mindenki emlékszik általános iskolai matekórán a GÉP-re. Ezzel magyarázta el a matektanár a műveletek fogalmát. Bedobok egy számot és eggyel nagyobbat kapok, vagy egy másik gép megszorozza kettővel. Egy PDP háló meg tudja tanulni, hogy 1 után 2, 3 után 4 jön, de ha megkérded mi jön 5 után akkor valamit halangzsázni fog, mert ezzel a párral még nem találkozott. Bár egy kellően nagy és mély háló mint mostanában a ChatGPT esetében láthatjuk már ha jól kérdezzük képes erre.

Ez egy nagyon komoly problémájuk, mert ez alapján nem magyarázható meg hogyan képes az emberi agy logikusan gondolkodni és szabályokat alkotni. Ez volt számomra az egyik legnagyobb fennálló probléma az agyműködés megértésében és közel 30 évig nem tudtam vele mit kezdeni. Az #agyséta során, amikor majd az agyi hálózatok tér és időbeli dinamikáját, valamint a homloklebeny szerepét tárgyaljuk szerencsére fény derül a megoldásra. Spoiler: a dolog megoldása az lesz, hogy a Konnekcionista alapokon nyugvó agyi hálózatok egy magasabb szinten még egyszer többszintű, visszacsatolt hálózatba kapcsolódnak. Ez a meta-hálózat képes lesz a feladatok elemekre bontására.

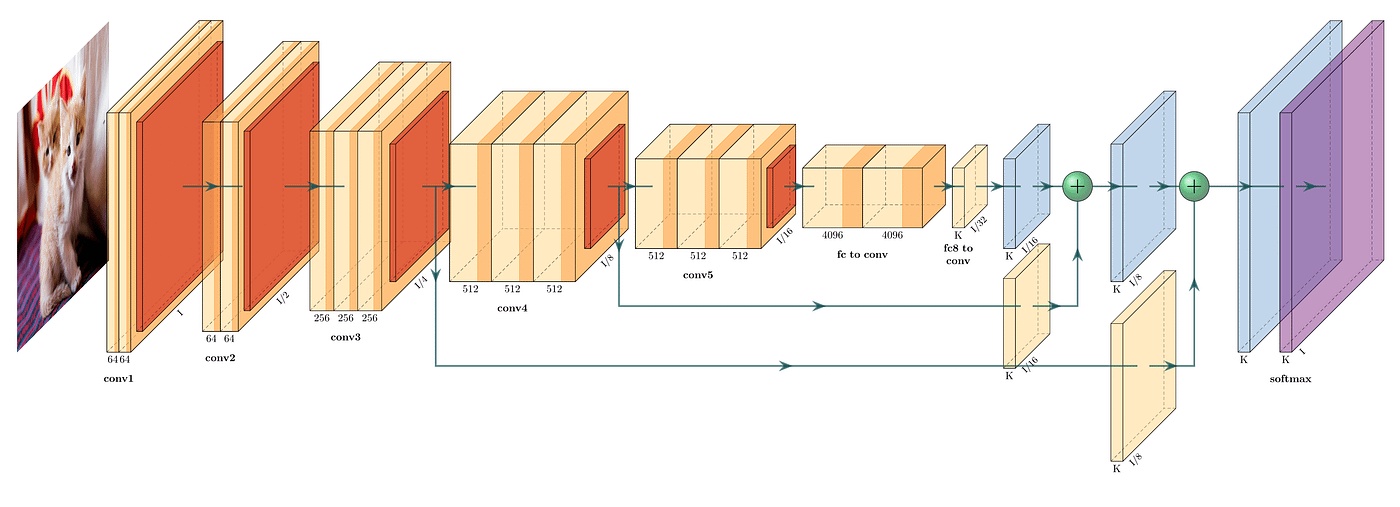

A fenti probléma vezetett a „Connectionism versus Computionalism” azaz a „Kapcsolatok vagy Számítás” vitához. Jerry Fodor és Steven Pinker elvetették a PDP megközelítést, mivel nem lehetett vele megmagyarázni a logikus gondolkodás és érvelés elemeit, a mentális struktúrák jelenlétét. Ellenállásuk komolyan hozzájárult az „AI winter”, az „MI tél” korszak bekövetkeztéhez. Ez alatt a 1980-2010-ig tartó időszak alatt nem sokat haladt a neuronhálózatokon alapuló MI rendszerek fejlődése.  Ennek a Konnekcionista megközelítés, mára mindent taroló formája a Deep Learning vetett véget, mely az agy működéséről időközben szerzett tudásunkhoz visszanyúlva nagyon sok rétegű, hierarchikusan szervezett, elágazó rendszerekbe csatolt neuronhálózatokat használ. A ChatGPt mögött egy 600 rétegű és több millió modell idegsejtből álló hálózat áll. De persze itt is előjön, hogy fogalmunk nincs mi történik ezekben a hálózatokban. Ezért új tudományágak, az AI pszichológus (prompt engineer), AI pszichiáter és AI tanár vannak kialakulóban, melyek megpróbálják megérteni milyen struktúrákban gondolkodnak ezek a hálók és hogyan lehet őket javítani, hatékonyabban tanítani.

Ennek a Konnekcionista megközelítés, mára mindent taroló formája a Deep Learning vetett véget, mely az agy működéséről időközben szerzett tudásunkhoz visszanyúlva nagyon sok rétegű, hierarchikusan szervezett, elágazó rendszerekbe csatolt neuronhálózatokat használ. A ChatGPt mögött egy 600 rétegű és több millió modell idegsejtből álló hálózat áll. De persze itt is előjön, hogy fogalmunk nincs mi történik ezekben a hálózatokban. Ezért új tudományágak, az AI pszichológus (prompt engineer), AI pszichiáter és AI tanár vannak kialakulóban, melyek megpróbálják megérteni milyen struktúrákban gondolkodnak ezek a hálók és hogyan lehet őket javítani, hatékonyabban tanítani.

Szerző: Gulyás Attila